Die Analyse von Sensordaten in der Produktion: das ‘Warum’, das ‘Wann’ und das ‘Wie’

Schauen Sie auf irgendein elektrisches Gerät vor Ihnen – es ist höchstwahrscheinlich, dass es Sensoren enthält. Und nicht nur elektrische Geräte: heute sind auch Bäume und Gebäude mit Sensoren ausgestattet. Und sie sind hier aus einem bestimmten Grund: Menschen schöpfen Wert aus ihren Lesungen. Wenn Sie also glauben, dass Sensoren in Ausrüstung bei Ihren Fabriken potenziell auch einen Gewinn bringen, haben Sie recht. Aber das bloße Gefühl reicht nicht aus. Bevor Sie sich an die Spezialisten für eine Big-Data-Beratung wenden, müssen Sie die Grundlagen der Sensoranalyse verstehen, um einen echten Nutzen aus Sensordaten zu ziehen. Und genau darüber finden Sie Informationen weiter unten.

Das "Warum"

Warum Sie Sensordaten analysieren sollten, hängt davon ab, was genau Ihr Unternehmen benötigt. Gewöhnlich analysieren Hersteller Sensordaten, um Prozesse zu überwachen/optimieren oder Produkte zu entwerfen.

1. Überwachung

Die Überwachung setzt in der Regel die folgende Vorgehensweise voraus: Sie erstellen ein Fehlermodell, um einen Ausfall definierende Parameter zu bestimmen, dann analysieren Sie Sensordaten, erkennen fehlerhafte Muster anhand des Modells und korrigieren sofort Fehler, um den normalen Ablauf Ihrer Prozesse wiederherzustellen.

An einem bestimmten Beispiel würde es so aussehen. Ein Hersteller von Kunststoffprodukten, der Sensoren an seinen Geräten hat, kann alle Phasen seines Produktionsprozesses überwachen. Wenn also die Temperatur des geschmolzenen Kunststoffs einen maximal zulässigen Wert erreicht, kann man die Temperatur des Kunststoffs senken und dadurch einen Oberflächendefekt auf dem Endprodukt verhindern. Das ermöglicht, die mit mangelhaften Waren verbundenen Kosten zu minimieren und eine bessere Qualitätssicherung zu erreichen.

Die Prozessüberwachung gibt auch eine gute Möglichkeit, die vorausschauende Wartung in einer Fabrik in Gang zu setzen (durch Predictive Analytics). Sensordatenanalysen können Ihr Wartungsteam vor fehlerhaften Mustern in der Produktion warnen. Und das ermöglicht, die Anlagen, die bald ausfallen können, rechtzeitig zu reparieren und teure Ausfallzeiten zu vermeiden.

2. Optimierung

Die Optimierung von Produktionsprozessen bedeutet, den gesamten Produktionszyklus (oder einen bestimmten Teil davon) zu analysieren, wichtige beeinflussende Parameter zu identifizieren und diese abzustimmen, sodass die Ausbeute erhöht, der Output stabilisiert oder die Qualität verbessert werden.

Nun schauen wir uns an, wie es für einen Reifenhersteller funktionieren kann. Nach der Analyse von Sensordaten zeigt ihr Big-Data-Analyse-Tool eine Besonderheit im Prozess. Wenn ein Reifen 6% mehr Schwefel enthält und die Temperatur des Dampfs, der in den Ballon der Reifenform gepumpt wird, um 9% niedriger ist, ist die Ausgabequalität um 12% höher als durchschnittlich. Das Analyseteam stellt außerdem fest, dass die Einsparung von Kosten für Dampfheizung die zusätzlichen mit Schwefel verbundenen Ausgaben überwiegt. des Weiteren: je niedriger die Temperatur des Dampfes ist, desto länger dauert es, bis sich die Reifenformen verschleißen. Der Hersteller stimmt mit dieser Erkenntnis dementsprechend seine Schlüsselparameter in der Produktion ab und kann als Ergebnis gleichzeitig Geld sparen und Qualität verbessern.

3. Produktdesign

Unter Berücksichtigung der Ergebnisse von Sensoranalyse und der Leistungsmerkmale der schon verwendeten Produkte können Hersteller bessere Produkte entwerfen.

Betrachten wir als Beispiel die Hersteller von Smartphones. Um neue Modelle zu entwickeln, verwenden sie neben anderen Erkenntnissen über Design auch Sensorendaten, die auf getesteten Prototypen und Smartphones, die bereits im Einsatz sind, installiert werden. Die Daten von Prototypen zeigen, ob der Hersteller aus technischer Sicht etwas Gutes gestaltet hat. Und die Im-Einsatz-Sensoren zeigen, welche Lücken von früheren Modellen behoben werden müssen und auf welche nicht so beliebten technischen Features man verzichten kann.

Das "Wann"

Wann Sie Ihre Sensordaten analysieren, muss das eigentlich auf den spezifischen Aufgaben basieren, die Sie durchführen müssen. Vielleicht denken Sie, es wird nur einmal reichen, wie bei einer einmaligen Prozessoptimierung. Aber nachdem Sie den süßen Big-Data-Analytics-Kuchen zusammen mit dem Gewinn, den er bringt, probiert haben, werden Sie wahrscheinlich mehr wünschen. Und es gibt zwei Modelle, die beschreiben, wann Ihre Sensordaten analysiert werden: Ad-hoc und in Echtzeit.

1. Ad-hoc-Sensorenanalyse

Ad-hoc-Analyse von Sensordaten bedeutet, dass Sie Ihre Sensordaten nur bei Bedarf auf Anforderung einsehen können. In der Regel wird solche Analyse von einem Team von Datenwissenschaftlern oder Analysten durchgeführt.

Hier ist ein Beispiel. Ein Chemiehersteller ist unsicher, wie häufig er seine industriellen Luft- und Wasserfilter wechseln muss. Das Unternehmen tut es alle 3 Monate, wie die Anleitung sagt. Er weiß aber nicht, ob die Berechnungen des Filter-Herstellers die Besonderheiten seiner chemischen Produktion berücksichtigen, was die Emission giftiger Dämpfe voraussetzt.

Die Analyse der Daten von Anlagen- und Filtersensoren zeigt, dass die Chemiefabrik eigentlich jeden Monat Filter wechseln sollte. Außerdem sollte man einen anderen Filtertyp wählen, weil derjenige, der verwendet wird, nicht gut genug ist, um toxische Abfälle zu handhaben. Dadurch kann die Fabrik einen großen ökologischen Skandal und eine Geldstrafe der Regierung vermeiden.

2. (Nahezu)-Echtzeit-Sensoranalyse

Im Gegensatz zu Ad-hoc strömt allein der Name "Echtzeit-Analyse" den Hauch von Schnelligkeit aus. Und das geschieht, ohne Absicht irrezuführen: Echtzeit-Sensoranalysen liefern einen konstanten Fluss von Analyseergebnissen.

Laut diesem Artikel verstehen aber verschiedene Unternehmen das Wort "Echtzeit" unterschiedlich. Für einige kann das ein Intervall von 40 Millisekunden zum Sammeln und Analysieren von Daten bedeuten. Während für andere ein Intervall von 30 Minuten auch relativ in Echtzeit wäre. Und es gibt viele Probleme, die aus der Sensordatenanalyse hervorgehen, und das richtige Intervall für die Echtzeit-Analyse zu wählen, ist eines davon.

Ein perfektes Beispiel für das Intervall von 40 Millisekunden wäre die Echtzeit-Analyse einer Windkraftanlage. Während sie Daten mit einer Geschwindigkeit von 40 Millisekunden sammelt und analysiert, verwendet das Analytics-Tool sie zum Beispiel, um eine optimale Art und Weise zu finden, den Pitch (deutsch: die Steigung) der Rotorblätter zu verstellen. Und es ist leicht, so eine hohe Geschwindigkeit der Datenerfassung zu begründen: es hängt von der veränderbaren Natur des Windes ab.

Während für das Intervall von 30 Minuten ein Solarpark als Beispiel angeführt werden könnte, wäre es definitiv zu viel, alle 40 Millisekunden Daten über solare Energieumwandlung zu übermitteln. Wenn sich der Sonnenstrahlungswinkel mit der Zeit ändert, kann das Solarmodul seine Position dem Sonnestand anpassen, um mehr Energie umzuwandeln. Unter Berücksichtigung dieser Tatsache könnte ein Datensammlungs- und Analyseintervall von 30 Minuten nützlich sein.

Das “Wie”

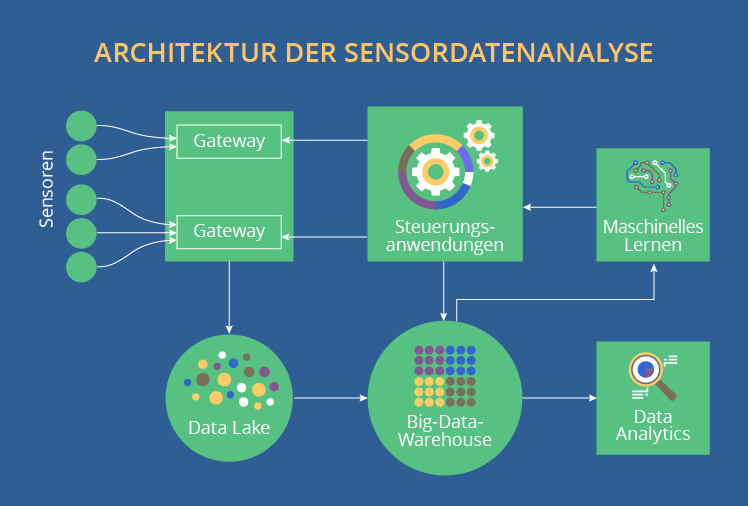

Wie Sie Ihre Sensordaten analysieren, hängt das auch von Ihren speziellen Bedürfnissen, Aufgaben und Kontext ab. Aber es gibt einige Best Practices. Und im Laufe der Zeit haben unsere Big-Data-Beratungsexperten eine Architektur entwickelt, die für nahezu jede Sensordaten-Analyselösung geeignet ist. Es kann einer IoT-Architektur ähneln.

Der Ausgangspunkt ist ein Sensor. Wenn Daten von ihrem "Host" gesammelt und an Gateways übertragen werden, werden die Daten gefiltert und in einen Data Lake (Datensee) verschoben.

Der Data Lake ist ein Speicher, der Daten in ihrem ursprünglichen Format aufnimmt, bis Sie diese analysieren müssen. Dann werden die Daten extrahiert, transformiert ("gut gekleidet und gepflegt") und in ein Big-Data-Warehouse geladen.

Das Big-Data-Warehouse ist der Ort, an dem die gereinigten, gut gekleideten und gepflegten Daten gespeichert und für die Analyse verwendet werden. Neben einem Data Lake erhält ein Big-Data-Warehouse Daten auch von den Steuerungsanwendungen, die die Aktoren steuern. Es speichert auch Daten über Ihre Maschinenkonfigurationen, die Orte, an denen bestimmte Sensoren eingesetzt werden, und alle anderen Informationen, die Ihre Sensordaten in Zusammenhang setzen. Auf diese Weise "weiß" das Warehouse nicht nur, welche Sensoren Daten übertragen, sondern auch, wo sie sind und was Ihr System ihren Aktoren gesagt hat.

Und es gibt natürlich ein Segment für Data Analytics. Hier findet die Analyse selbst statt. Es ist die wahre Quelle von allen wertvollen Geschäftsinformationen, die Sie erhalten können.

Die letzte und "intelligenteste" Form der Sensordatenanalyse ist maschinelles Lernen. Es beobachtet Ihre Sensordaten, bemerkt neue Muster, erstellt neue Modelle für Steuerungsanwendungen und setzt sie um. Auf diese Weise wird Ihre Sensoranalyse immer aktualisiert.

Ein bisschen mehr zu Data Lake vs. Big-Data-Warehouse

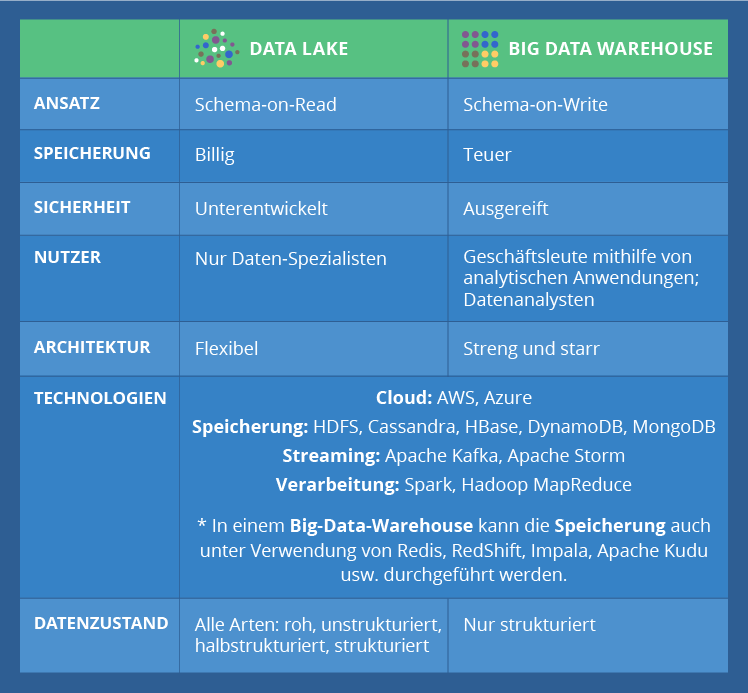

Der Hauptunterschied zwischen einem Data Lake und einem Big-Data-Warehouse ist der Ansatz zur Datenspeicherung:

- Bei einem Big-Data-Warehouse ist alles schwierig: bevor Sie es laden, müssen Sie es filtern, verarbeiten, integrieren und modellieren. Sie müssen den Daten ein richtiges "Aussehen" geben – Form und Struktur. Dieser Ansatz wird Schema-on-Write genannt.

- Bei einem Data Lake ist das alles einfacher: Sie brauchen nicht viel Aufwand, um Daten vorzubereiten und Daten-Staging zu machen. Sie nehmen diese einfach und laden sie in den Lake. Ohne Mühe. Dieser Ansatz wird Schema-on-Read genannt.

Jetzt können Sie sehen, warum die Speicherung aller Ihrer Daten in einem Big-Data-Warehouse teuer ist: stellen Sie sich vor, wie viele Sensordaten Sie "verfeinern" müssen und wie viel Ressourcen dafür benötigt werden.

Alle Unterschiede zwischen einem Data Lake und einem Big-Data-Warehouse liegen in dieser handlichen Tabelle.

Ein bisschen mehr zum maschinellen Lernen

Und so funktioniert's. Ein Datenwissenschaftler, zusammen mit einem Betriebsingenieur, nehmen wir an, in einer Flugzeugmotorenfabrik, wählen eine Reihe von einflussreichen Prozessparametern aus. Dann durcharbeitet der ML-Algorithmus eine große Menge von Sensordaten für diese Parameter und erstellt Modelle. Bei Flugzeugtriebwerken könnte das Ergebnis etwa so aussehen: Wenn der Druck 18% unter dem Durchschnitt liegt und die Legierung 7% mehr Aluminium enthält, führt das mit 78% Wahrscheinlichkeit zu einer Steigerung der Endproduktqualität. Danach testet das Team das Modell manuell und wenn das Modell gehemigt wird, kommt es in Steuerungsanwendungen zum Einsatz.

Der Hauptvorteil von Maschinenlernmodellen ist Ihre Genauigkeit. Das ist der Hauptgrund für die Rivalität zwischen Herstellungsexperten und ML. Wenn sie sagen, dass die Temperatur 15°C betragen sollte, kann ein ML-Algorithmus feststellen, dass die tatsächlich 15,4°C betragen sollte. Und ein Big-Data-Analytics-Tool wird Ihnen sagen, dass die Differenz von 0,4°C einen erheblichen finanziellen Unterschied machen wird.

Technologien für maschinelles Lernen sind Spark Machine Learning Bibliothek (MLlib), Amazon Machine Learning, Azure ML Studio, TensorFlow, Theano, Torch usw.

Das ‘Also’

Also, um alles zusammenzufassen, denken Sie daran, dass Sie Ihre Sensordaten analysieren können:

- In regelmäßigen Abständen oder auf Anfrage.

- Indem Sie Data Lakes, Big-Data-Warehouses und Algorithmen vom maschinellen Lernen verwenden.

- Um Ihre Prozesse zu überwachen, zu optimieren und neue Produkte zu entwickeln.

Aber in erster Linie denken Sie daran, dass sensorbasierte Big-Data-Analysen Ihr Unternehmen zu etwas Faszinierendem machen können. Und das ist kein leeres Versprechen: es gibt eine ganze Reihe von Anwendungsfällen von Big Data für die sensorgestützte Produktion, die das beweist.